Wer KI nutzt, arbeitet produktiver

Künstliche Intelligenz

TÜV AI.Lab

Künstliche Intelligenz findet zunehmend Eingang in alle Bereiche der Gesellschaft. Immer häufiger werden auch KI-Systeme eingesetzt, die Auswirkungen auf Leib und Leben von Menschen oder ihre elementaren Grundrechte haben können. Das ist etwa der Fall bei Systemen zur Früherkennung von Krebszellen auf MRT-Scans oder selbstfahrenden Fahrzeugen mit automatischer Verkehrsschilderkennung. Damit KI-Systeme im Sinne der Menschen eingesetzt werden, sind unterschiedliche Formen der Regulierung und Prüfung notwendig.

Als eigenständiges Joint Venture der TÜV-Unternehmen TÜV Hessen, TÜV NORD, TÜV SÜD, TÜV Rheinland und TÜV Thüringen wurde das TÜV AI.Lab 2023 gegründet. Seitdem verfolgt es das Ziel, die regulatorischen Anforderungen an KI in die Praxis zu übersetzen und Europa zum Hotspot für sichere und vertrauenswürdige KI zu machen. Hierfür entwickelt es quantifizierbare Konformitätskriterien und geeignete Prüfmethoden für Künstliche Intelligenz. Zudem unterstützt das TÜV AI.Lab die Entwicklung von Standards und Normen für KI-Systeme.

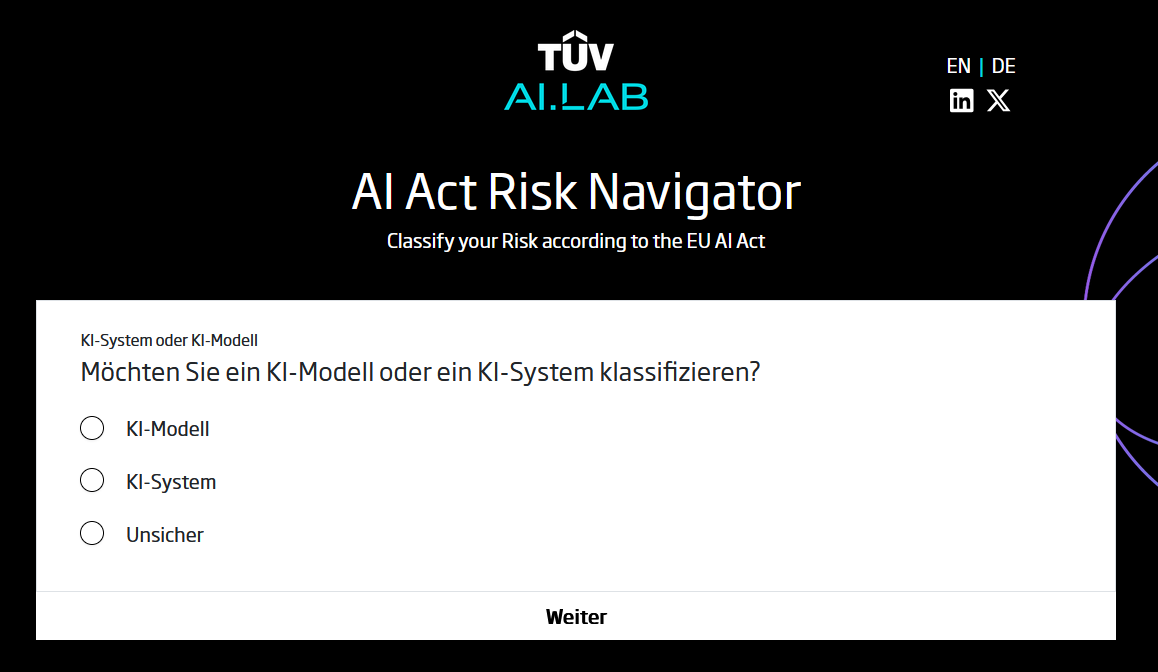

AI Act Risk Navigator

AI Act Risk Navigator

Der vom TÜV AI.Lab entwickelte AI Act Risk Navigator ist ein kostenloses Klassifizierungstool zur einfachen und präzisen Einordnung von KI-Systemen und -Modellen in die Risikoklassen der europäischen KI-Verordnung.

Das TÜV AI.Lab – ein Joint Venture von

Neuigkeiten

Kontakt